Die ML-basierte Computer Vision hat sich durch gezielte Forschung, um den Stand der Technik voranzutreiben, und durch Unternehmensinvestitionen zum Aufbau oder zur Nutzung einer unternehmensfähigen Plattform erheblich weiterentwickelt. Was die Funktionalität betrifft, so hat sich die genaue, zuverlässige räumliche Analyse für die Objekterkennung und Bildklassifizierung allmählich zu einer räumlich-zeitlichen Analyse für die Verfolgung des Objektzustands (z. B. menschlicher Bediener) in Bezug auf Form, Orientierung (z. B. Pose eines menschlichen Bedieners) und Interaktion mit der Umgebung (z. B. Handlungen menschlicher Agenten in verschiedenen Landschaften) entwickelt. Unternehmensplattformen für die Entwicklung umfassender industrieller Anwendungsfälle sind in der Entwicklung, wobei verschiedene architektonische und technologische Optionen zum Einsatz kommen.

Was ist der Kontext?

Anfang 2010 wurden ML-basierte Computer-Vision-Ansätze bei der räumlichen Analyse von Bildern, d. h. bei der Klassifizierung von Bildern und der Erkennung von Objektdetails in Bildern, in Bezug auf Leistung, Rechenkosten und Produktionsreife weiterentwickelt.

Die Algorithmen haben bei komplexen Trainingsdatensätzen, die sowohl allgemein als auch bereichsspezifisch sind, hervorragende Ergebnisse erzielt und ermöglichen Anwendungen in offenen und geschlossenen Kreisläufen in allen Branchen. Anbieter von Unternehmens- und Verbrauchertechnologien entwickeln innovative Produkte zur Erkennung von Objekten (einschließlich Gesichtern), zu deren Klassifizierung und Lokalisierung sowie zur Messung der Anzahl von Instanzen verschiedener Objekttypen im eingegebenen Bild.

VERBUNDENER BLOG

Im Großen und Ganzen wurden diese Anwendungen für die punktuelle Bildanalyse eingesetzt, mit wenig Korrelation zwischen den einzelnen Bildern. Dies schränkt den Nutzen der Erkenntnisse und Arbeitsabläufe ein, die sich aus den Ergebnissen dieser Anwendungen ergeben - aufgrund der fehlenden zeitlichen Dimension in der Analyse fehlen die Bewertung der Kausalität und die Vorhersage des Objektzustands im Bild. Ein Beispiel, bei dem diese Analyse von besonderem Interesse ist, ist die Beobachtung und Analyse der Handlungen von Menschen, die verschiedene industrielle, kommerzielle und individuelle Aufgaben im Laufe der Zeit ausführen.

Was sind die technologischen Überlegungen?

Das Kernproblem ist hier die Verfolgung des Objektzustands. Der Objektzustand wird auf zwei Arten beschrieben. Die Form des Objekts (Form, Größe, Merkmale), die Ausrichtung und die Position im Bild werden als räumliche Informationen bezeichnet. Die oben genannten Algorithmen zeichnen sich durch die Erfassung dieser Attribute in Bildern aus, selbst bei starker Verdeckung (ein anderes Objekt, ein Kontext, der das interessierende Objekt teilweise verdeckt), schwachem Licht und gelegentlicher Unschärfe.

Wir wollen aber auch verstehen, wie sich der Objektzustand im Laufe der Zeit verändert. Die Information, die die Veränderung des Objektzustands im Laufe der Zeit zeigt, wird als zeitliche Information bezeichnet. Ziel der Lösung ist daher die Analyse und Erstellung eines Zustandsübergangsmodells unter Verwendung der räumlich-zeitlichen Informationen für die Objekte im Sichtfeld.

Dies erforderte in der Regel einen komplexen Algorithmus mit Modellen, die im Tandem arbeiten, um zwei Hauptaufgaben zu erfüllen

- Identifizierung und Lokalisierung von Objekten im Sichtfeld des Videos - dies geschieht mit Hilfe einer CNN (Convolution Neural Network)-basierten Backbone-Modellpipeline zur Objekterkennung und -lokalisierung

- Verfolgen, wie sich der Zustand des Objekts ändert (meist Form und Ausrichtung) - dies geschieht mithilfe eines RNN (Reinforced Neural Network) basierten Modells, das hervorragend in der Lage ist, Veränderungen über die Zeit zu verfolgen

In den letzten Jahren wurden verschiedene Ansätze erwogen und umgesetzt. Jeder davon hat sich als Stand der Technik durchgesetzt und den Weg für das nächste Modell geebnet, das das Leistungsniveau noch weiter anhebt.

Wir werden uns die Algorithmen, die diese Lösungsansätze umfassen, später in dieser Reihe genauer ansehen.

Was sind die typischen Anwendungen?

Die Videoerkennung findet in zahlreichen Branchen und Geschäftsprozessen Anwendung

- Erkennung menschlicher Aktivitäten - Die skelettbasierte Aktivitätserkennung ist nützlich, um die Einhaltung von Prozessen zu gewährleisten, bei denen bestimmte Aufgaben in einer festgelegten Reihenfolge von menschlichen Bedienern ausgeführt werden müssen. Die Prozesse können in den Bereichen Handel, Industrie und Gesundheitswesen stattfinden. Einige mögliche Anwendungsfälle sind:

- Industrielle Fertigung - Fließbandproduktion und Qualitätskontrolle von Fertigerzeugnissen

- Einzelhandel - Merchandising und Regalbestückung, Umgang mit verderblichen Gütern

- Logistik und Lagerhaltung - Handhabung von Frachtpaletten (innerhalb des Lagers), Handhabung von zerbrechlichen/ wertvollen Gütern beim Be- und Entladen, Einhaltung der SOP (während des Transports)

- Gesundheitswesen - Überwachung von Patienten und Pflegepersonal, insbesondere bei kritischen Fällen und Traumata

- Überwachung und Kontrolle chirurgischer Geräte - Anwendungen im Gesundheitswesen wie die endoskopische Chirurgie erfordern Videoerkennung in schwach beleuchteten Umgebungen mit starker Objektverdeckung zwischen dicht gepackten Körperorganen, Blutgefäßen usw. In Anbetracht der hohen medizinischen Risiken (Gesundheit des Patienten, Langlebigkeit) und der hohen Eventualverbindlichkeiten (Versicherungs- und Prozesskosten aufgrund medizinischer Notfälle) ist eine genaue Wahrnehmung für präzise Steuerungsmaßnahmen am chirurgischen Gerät unerlässlich. Dabei handelt es sich um einen geschlossenen Kreislauf, und einige Aspekte, die eine robuste Erkennungslösung erfordern, sind:

- Überwachung der Nutzungsdauer der chirurgischen Instrumente - um die verbleibende Nutzungsdauer abzuschätzen und sicherzustellen, dass die Instrumente nicht mitten in der Operation das Ende ihrer Lebensdauer erreichen

- Sicherstellung bewährter Praktiken bei der Verwendung von Instrumenten - Einhaltung der empfohlenen, sicheren Verwendungsreihenfolge bei mehreren chirurgischen und diagnostischen Instrumenten im Anwendungsbereich

- Empfehlung der nächstbesten Maßnahmen - Bewertung des sich entwickelnden Zustandsübergangs der chirurgischen Aktivität unter Verwendung von Videoübertragungen und anderen verfügbaren Sensorübertragungen, um Maßnahmen mit einer Bewertung der Erfolgswahrscheinlichkeit vorzuschlagen

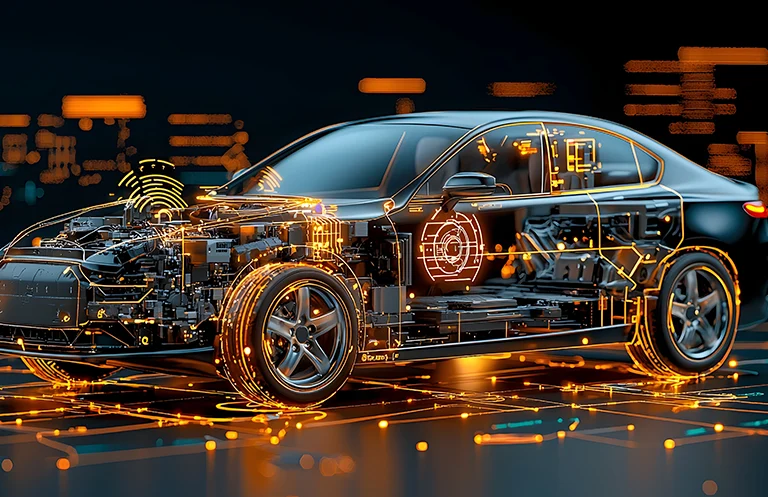

- Wahrnehmung und Steuerung autonomer Systeme - Automobilanwendungen wie ADAS (insbesondere L3 und höher) sowie autonome Anwendungen für die Handhabung von Industrieanlagen und die Navigation unter schwierigen Umgebungsbedingungen benötigen eine kontinuierliche, genaue Wahrnehmung der genannten Umgebung in Echtzeit. Nur wenn der Edge-ML-Agent dieses genaue Zustandsübergangsmodell durch die Verarbeitung der Videoübertragungen erstellt hat und mit angemessener Genauigkeit und Zuversicht vorhersagen kann, wie der unmittelbare zukünftige Zustand aussehen könnte, ist er in der Lage, fundierte Steuerungsentscheidungen zu treffen, die zum gewünschten Ergebnis führen.

VERBUNDENER BLOG

Wer bringt den Stand der Technik voran?

Die Videoerkennung steht im Fokus vieler Forschungsgruppen aus dem Bereich des maschinellen Lernens, sowohl im akademischen Bereich als auch in der Industrie. Akademische Einrichtungen wie die Carnegie Mellon University (CMU) und Unternehmen wie Facebook haben durch ihre Arbeit an OpenPose und SlowFast Networks dazu beigetragen. Das Feld entwickelt sich jedoch noch weiter, da diese Lösungen in den Mainstream-Anwendungsfällen von Unternehmen eingesetzt werden.

eInfochips arbeitet mit Kunden aus Branchen wie dem Einzelhandel, dem Transportwesen und der industriellen Fertigung an der Entwicklung von ML-basierten Lösungen, die Computer-Vision-Pipelines für die Erkennung und Verfolgung von Objekten, die Erkennung von Aktivitäten und die Schätzung von Posen sowie Anwendungen zur Verarbeitung natürlicher Sprachen wie die Erkennung von Entitäten und die Analyse von Gefühlen nutzen. Für weitere Informationen kontaktieren Sie uns bitte noch heute.